发布日期:2025-01-03 17:21 点击次数:151

我是万万没念念到,就在西方还千里浸在圣诞假期,随心 “ 过年 ” 的时候,我们中国企业给东谈主家放了个新年二踢脚巨乳 乳首,给东谈主家脑瓜子崩得嗡嗡得。

前有宇树科技的机器狗视频让宇宙惊呼,还要啥波士顿能源。

紧接着又来了个国产大模子 DeepSeek,致使有股作念空英伟达的滋味。

具体咋回事儿,咱给你唠显明咯。

前几天, DeepSeek 刚刚公布最新版块 V3 ,审视,与大洋此岸阿谁自称 Open ,却越来越 Close 的公司产物不同,这个 V3 是开源的。

不外开源还不是他最蹙迫的标签, DeepSeek-V3 ( 以下简称 V3 )还兼具了性能海外一流,本事力过劲,价钱击穿地心三个特色,这一套不明释连招打得业内大模子厂商们王人有点浑浑噩噩了。

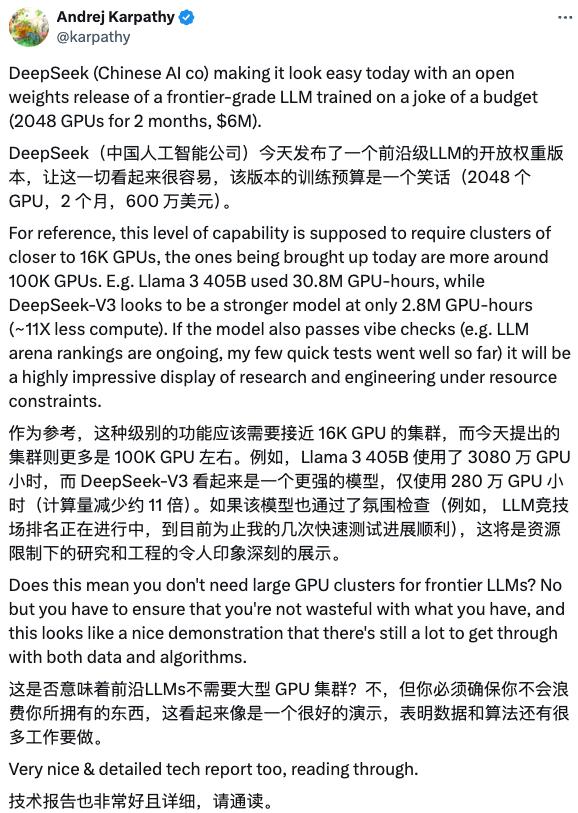

V3 一发布, OpenAI 创举成员 Karpathy 径直看嗨了,致使发出了灵魂发问,难谈说大模子们根柢不需要大领域显卡集群?

我揣摸老黄看到这头皮王人得发麻了吧。

同期, Meta 的 AI 本事官亦然直呼 DeepSeek 的遗弃伟大。

著名 AI 评测博主 Tim Dettmers ,径直吹起来了,暗意 DeepSeek 的管理优雅 “elegant” 。

而在这些本事耕作的东谈主,看着 V3 的成绩送去赞扬的时候,也有些东谈主急了。

比如奥特曼就搁那说,复制比拟简单啦,很难不让东谈主认为他在内涵 DeepSeek 。

更有理由的是,作念到这些的公司既不是什么大厂,也不是纯血 AI 厂商。

DeepSeek 公司汉文名叫深度求索,他们本来和 AI 没任何连络。

就在大模子爆火之前,他们其实是私募机构幻方量化的一个团队。

而深度求索能够完毕弯谈超车,既有点势必,也好像有点运谈的理由。

早在 2019 年,幻方就投资 2 亿元搭建了自研深度学习查考平台 “ 萤火虫一号 ” ,到了 2021 年还是买了足足 1 万张英伟达 A100 显卡的算力储备了。

要知谈,这个时候大模子没火,万卡集群的观念更是还没出现。

而恰是凭借这部分硬件储备,幻方才拿到了 AI 大模子的入场券,最终卷出了现时的 V3 。

你说好好的一个量化投资领域的大厂,干嘛要跑来搞 AI 呢?

深度求索的 CEO 梁文锋在继承暗涌采访的时候给宇宙聊过,并不是什么看中 AI 出息。

而是在他们看来, “ 通用东谈主工智能可能是下一个最难的事之一 ” ,对他们来说, “ 这是一个怎么作念的问题,而不是为什么作念的问题。 ”

即是抱着这样股 “ 莽 ” 劲,深度求索才搞出了此次的大新闻,底下给宇宙具体讲讲 V3 有啥异常的所在。

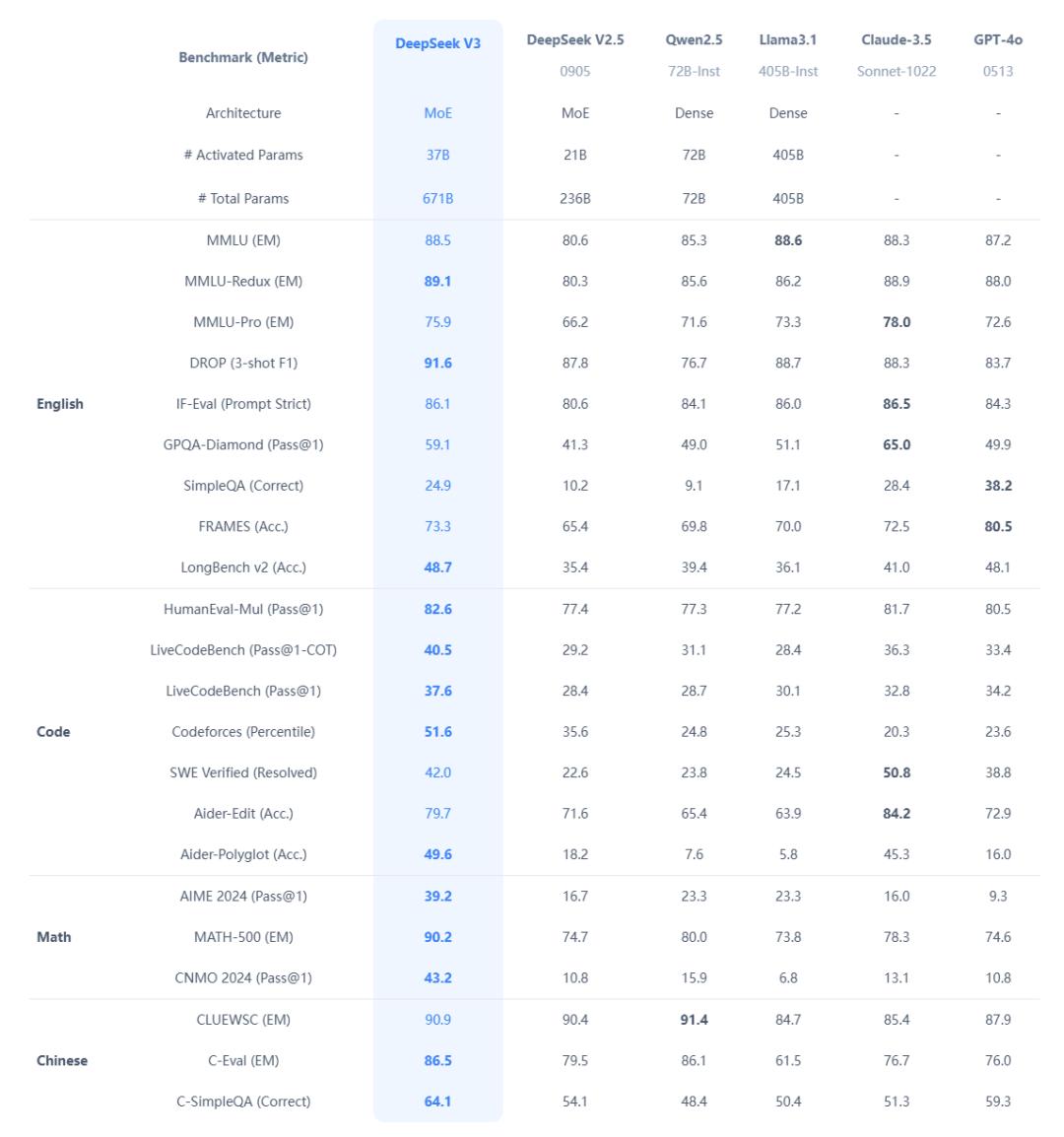

领先即是性能强悍,现时来看,在 V3 眼前,开源模子简直没一个能打的。

还记起前年年中,小扎的 Meta 推出模子 Llama 3.1 ,其时就因为性能优秀况兼开源,一时候被捧上神坛,遗弃在 V3 手里,基本是全面落败。

而在多样大厂手里的闭源模子,那些宇宙耳濡目染的什么 GPT-4o 、 Claude 3.5 Sonnet 啥的, V3 也能打得有来有回。

你看到这,可能认为不外如斯,也即是追上了海外杰出水平嘛,值得这样吹吗?

凶残的还在背面。

宇宙约略王人知谈了,现时的大模子即是一个通过多数算力,让模子吃多样数据的真金不怕火丹历程。

在这个真金不怕火丹期,需要的是多数算力和时候往里砸。

是以在圈子里有了一个新的计量单元 “GPU 时 ” ,也即是用了若干块 GPU 花了若干个小时的查考时候。

GPU 时越高,意味着糜掷的时候、财富本钱就越高,反之就物好意思价廉了。

前边说的此前开源模子王者, Llama 3.1 405B ,查考周期糜掷了 3080 万 GPU 时。

黑丝色情可性能更强的 V3 ,只花了不到 280 万 GPU 时。

以钱来换算, DeepSeek 搞出 V3 版块,约略只花了 4000 多万东谈主民币。

而 Llama 3.1 405B 的查考时间, Meta 光是在老黄那买了 16000 多个 GPU ,保守揣摸至少王人花了十几亿东谈主民币。

至于另外的那几家闭源模子,动辄王人是几十亿上百亿大撒币的。

你别以为 DeepSeek 靠的是什么歪门邪谈,东谈主家是正经八百的有本事傍身的。

为了搞明晰 DeepSeek 的本事咋样,我们挑升连络了语核科技创举东谈主兼 CTO 池光耀,他们主力发展企业向的 agent 数字职工,早即是 DeepSeek 的铁粉了。

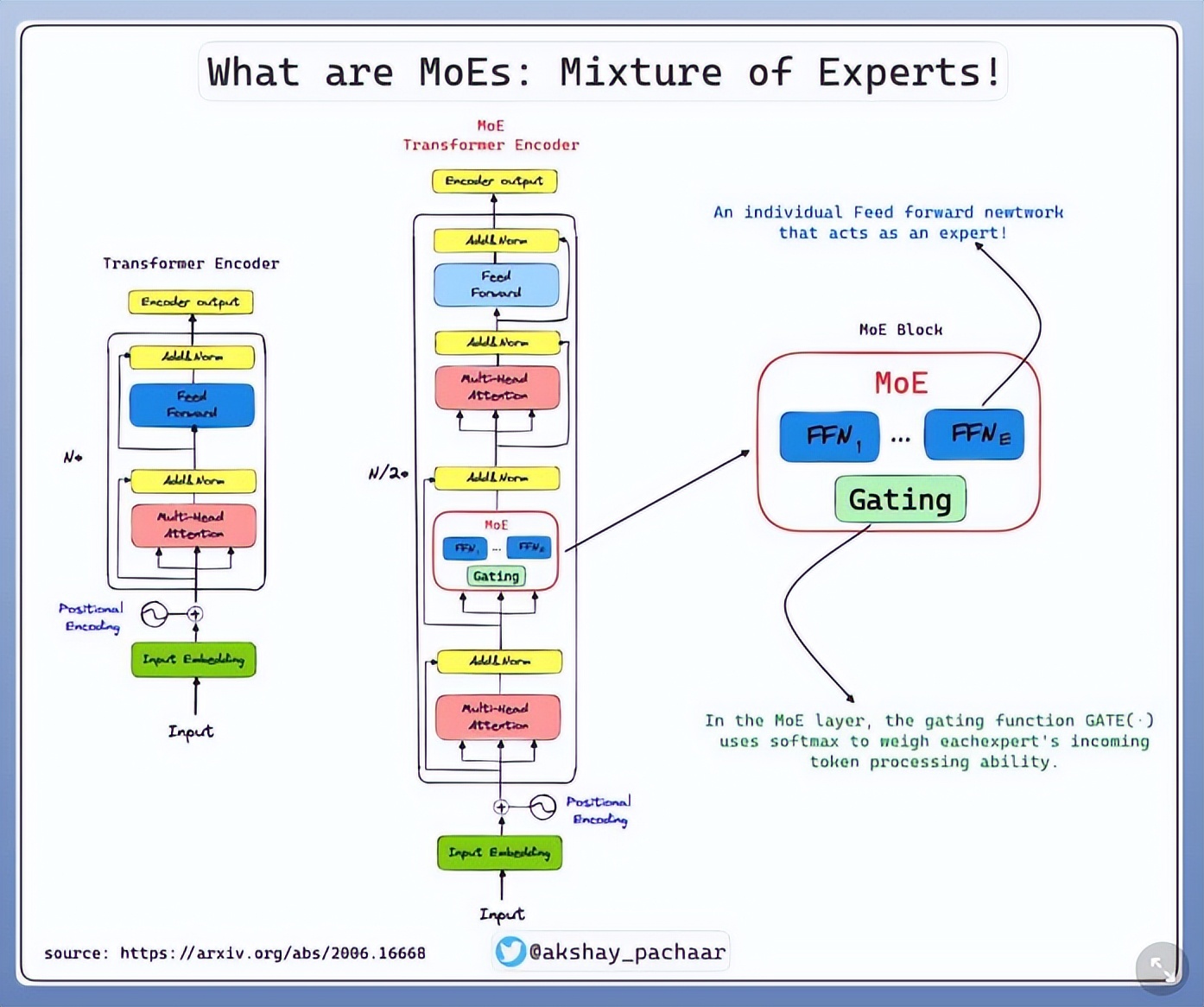

池光耀告诉我们,此次 V3 的更新主若是 3 个方面的优化,分离是通讯和显存优化、推理巨匠的负载平衡以及FP8 羼杂精度查考。

各个部分怎么完毕的咱也就未几说了,总体来说,大的全体结构没啥变化,更多的像是我们搞基建的那一套传统艺能,把工程作念得更高效、更合理了。

领先, V3 通过通讯和显存优化,极大幅度减少了资源安闲率,晋升了期骗着力。

而推理巨匠( 具备推理材干的 AI 系统或算法,能够通过数据分析得出论断 )的负载平衡就更玄妙了,一般的大模子,每次启动,必须把统共巨匠王人等比例放进工位( 显存 ),但真的恢复用户问题时,十几个巨匠内部只用到一两个,剩下的巨匠占着工位( 显存 )摸鱼,也干不了别的事情。

而 DeepSeek 把巨匠分红热点和冷门两种,热点的巨匠,复制一份放进显存,管理热点问题;冷门的巨匠也不摸鱼,老是能被分派到问题。

FP8 羼杂精度查考则是在之前被好多团队尝试无果的方朝上拓展了新的一步,通过裁减查考精度以裁减查考时算力支拨,但却神奇地保持了恢复质地基本不变。

也恰是这些本事上的改换,才赢得了大模子圈的一致好评。

通过一直以来的本事更新迭代, DeepSeek 成绩的答复亦然特等惊东谈主的。

他们 V3 版块推出后,他们的价钱还是是低到百万tokens几毛钱、几块钱。

他们致使还在搞了个新品促销举止,到来岁 2 月 8 号之前,在本来廉价的基础上再打折。

而一启动提到雷同开源的 Claude 3.5 Sonnet ,每百万tokens,至少王人得要几十块以上。。。

更要命的是,这对 DeepSeek 来说还是是通例套路了。

早在前年头,DeepSeek V2 模子发布后,就靠着一手廉价,被宇宙叫作念了AI 界拼多多。

他们还进一步激励了国内大模子公司的价钱战,诸如智谱、字节、阿里、百度、腾讯等大厂纷纷降价。

池光耀也告诉我们,他们公司早在前年 6 、 7 月份就启动用上了 DeepSeek ,其时也有国内其他一些大模子厂商来找过他们。

但和 DeepSeek 价钱差未几的,模子 “ 又太笨了,跟 DeepSeek 不在一个维度 ” ;如果模子材干和 DeepSeek 差未几,阿谁价钱 “ 基本王人是 10 倍以上 ” 。

更夸张的是,由于本事 “ 遥遥杰出 ” 带来的降本增效,哪怕 DeepSeek 卖得这样低廉,把柄他们创举东谈主梁文峰所说,他们公司如故获利的。。。是不是有种左近比亚迪搞 998 ,照样财报飘红的滋味了。

不外关于我们野蛮用户来说, DeepSeek 似乎也有点偏门了。

因为他的毅力主若是在推理、数学、代码标的,而多模态和一些文娱化的领域不是他们的所长。

况兼脚下,尽管 DeepSeek 说我方如故获利的,但他们团队上高下下王人有股极客味,是以他们的交易化比起其他厂商就有点弱了。

但无论怎么说, DeepSeek 的收效也讲解了,在 AI 这个赛谈还存在的更多的可能。

按往时的交融,念念玩转 AI 背面莫得个金主爸爸砸钱买显卡,根柢就玩不转。

但现时看起来,掌持了算力并不一定即是掌持了一切。

我们不妨期待下将来,更多的优化出现,让更多的小公司、初创企业王人能插足 AI 领域,差评君总嗅觉巨乳 乳首,那才是真的的 AI 波澜才对。